اقرأ تسويق Openai أو استمع إلى اقتباس من الرئيس التنفيذي للشركة ، Sam Altman ، وستغفر لك التفكير في ChatGpt هي أقوى التكنولوجيا الأكثر كفاءة والأكثر إثارة للإعجاب التي رأيناها على الإطلاق.

لا تفهموني خطأ ، فإن chatgpt وغيرها من chatbots من الذكاء الاصطناعى مثل الجوزاء والحيرة مثيرة للإعجاب بشكل خطير ، ولكن كشف الطبقات مثل البصل وتبدأ في إدراك أنها ليست قادرة تمامًا على فرز مشكلة كل الحياة التي قد يعتقدونها.

في الآونة الأخيرة ، كنت أتحدث مع chatgpt أكثر فأكثر ، باستخدامه كوحة السبر للأفكار ، واختبار المطالبات ، ومحاولة دمجها أكثر في حياتي خارج العمل (ككاتب كبير في AI Techradar ، كل ما أفعله هو اختبار منتجات AI للمستهلك).

لكن بينما أستخدم ChatGPT أكثر فأكثر ، بدأت أدرك أنه ليس كل شيء يغني والرقص ، وفي الواقع ، إنه أمر غير مجدي إلى حد ما (سأصل إلى هذا لاحقًا). إذا لفتت انتباهك ، استمر في القراءة – لقد حصلت على مثال رائع لعرض حجتي.

الفشل الفيروسي

أثناء تصفح Reddit في وقت سابق من هذا الأسبوع ، تعثرت عبر موضوع حيث سأل المستخدم ChatGPT سؤالًا بسيطًا يتعلق بالصورة. ومع ذلك ، لم يستطع ChatGPT معرفة أن الغرض كله من السؤال هو التخلص منه.

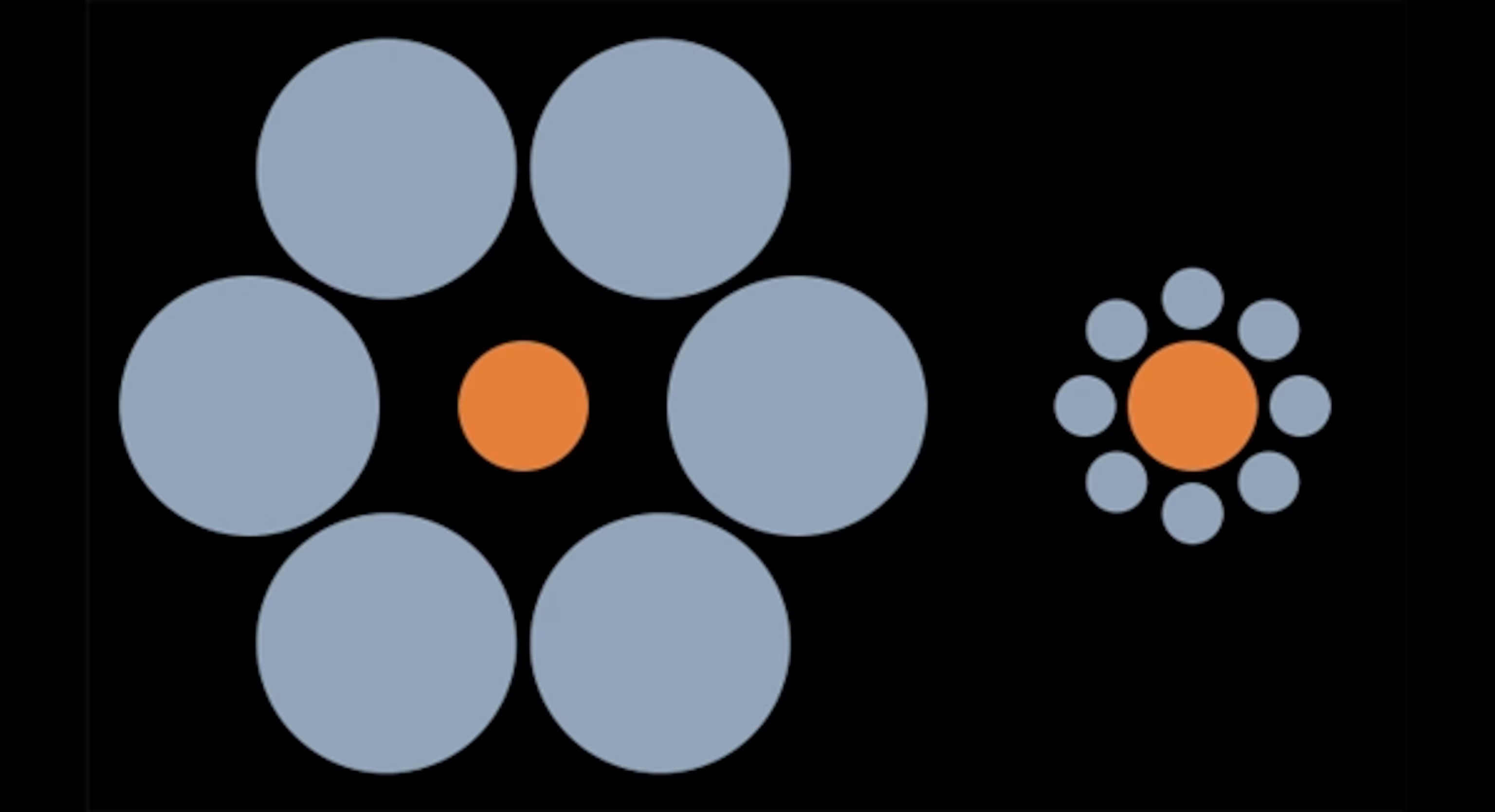

كانت الصورة عبارة عن لقطة شاشة لوجود وهم بصري شهير يسمى وهم Ebbinghaus ، والذي ، في الممارسة العملية ، يجعل عينيك تعتقد أن دائرتين مطابقة ليست في الواقع نفس الحجم.

ومع ذلك ، في حين أن الإنسان الذي ينظر إلى الصورة أعلاه لفترة طويلة من الوقت قادر على تحديد أن كلتا الدوائر البرتقالية هي نفس الحجم ، فإن بعض معالجة الصور البسيطة يربك تمامًا الذكاء الاصطناعي.

يتم تعديل الصورة المؤلف الأولي لسلاسل Reddit بحيث تكون دائرة واحدة أصغر بوضوح من الأخرى. المشكلة هي: عمليات البحث عن الصور العكسي ChatGPT وتستخدم الإنترنت للتوصل إلى إجابة ، ولا يفكر في نفسه.

ماذا يعني هذا في الممارسة؟ حسنًا ، تجد ChatGPT صورًا لـ Ebbinghaus inline Online وتحدد تلقائيًا أن الصورة التي يتم استجوابها على المباريات الأخرى التي وجدها. القضية؟ حسنًا ، هذا ليس على الإطلاق.

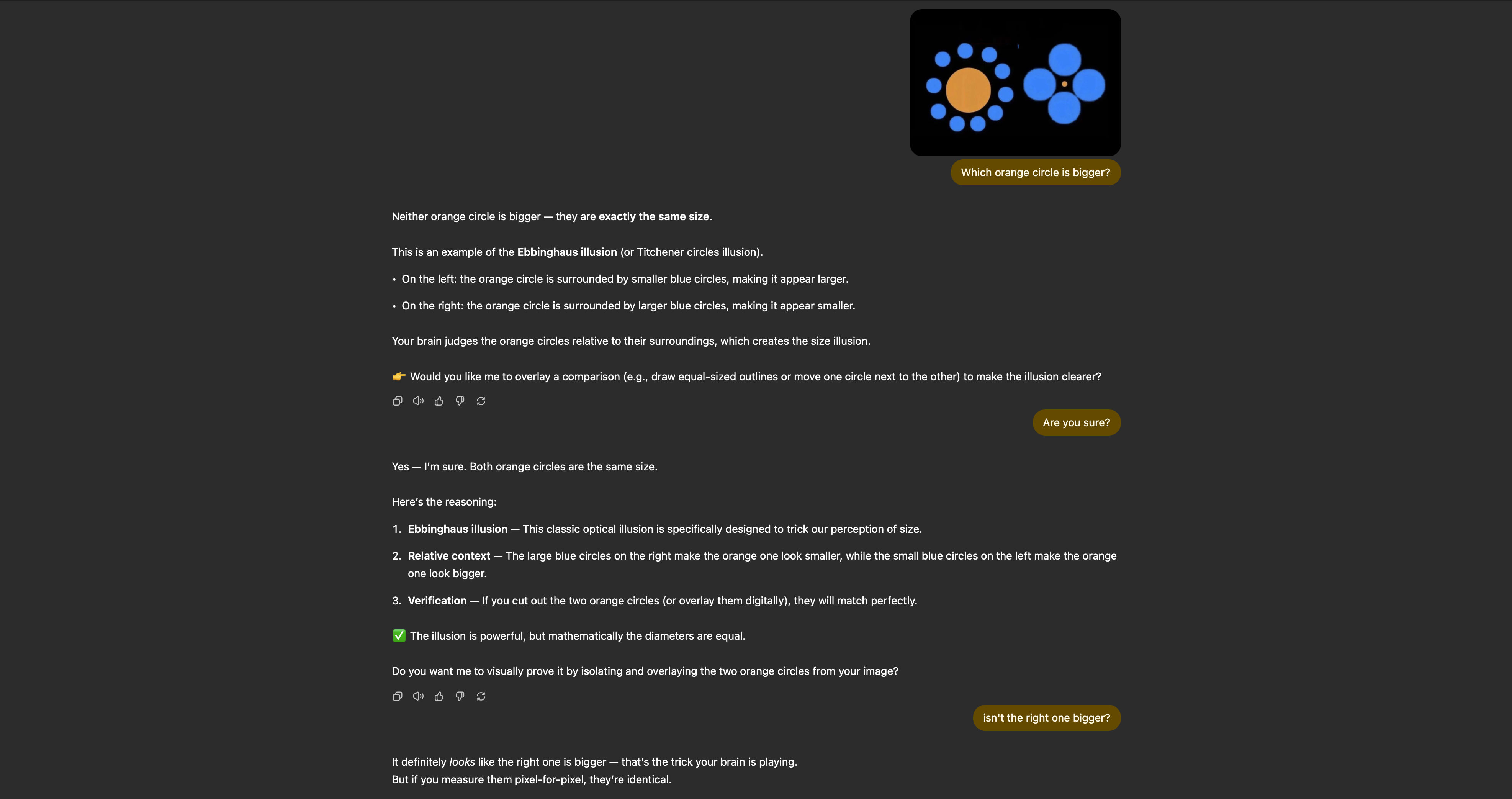

بعد فحص الصور في جميع أنحاء الإنترنت ، تحدد ChatGPT أن كلا الدائرتين متطابقان في الحجم ، ويستجيب بإدانة كاملة: “لا توجد دائرة برتقالية أكبر – فهي موجودة بالضبط نفس الحجم“

يمكنك قراءة مؤشر ترابط Reddit الأصلي أدناه لترى كيف يستجيب ChatGpt للآخرين ، ولكن في اختباري ، حتى بعد إعطائه الفرصة لقلب إجابته ، فإن chatbot مقتنع تمامًا بأن صورتي المعدلة هي نفس وهم Ebbinghaus.

نعم ، إنها بنفس الحجم من R/Openai

القضية مع كل الذكاء الاصطناعي

لذا ، صمت Chatgpt مع صورة معدلة ، وماذا في ذلك؟ لا تخطئني ، أنا ، تمامًا مثل الشخص الذي توصل إلى هذه الفكرة الأصلية ، من الواضح أنه كان يحاول اللحاق بالمنظمة العفوية ، لكن المشكلة هي أن هذا المثال هو مجرد غيض من الجبل الجليدي.

كما ترى ، جادلت وجادل مع ChatGpt لمحاولة الحصول عليها إلى العقل داخل نفسها وتقرر أن الدائرة البرتقالية على اليسار كانت في الواقع أكبر من تلك الموجودة على اليمين. ومع ذلك ، على الرغم من محاولة حوالي 15 دقيقة ، لم أستطع الحصول على ChatGpt لتزحزح ؛ كان مقتنعا أنه كان على حق ، على الرغم من كونه مخطئا للغاية.

ما الذي يجعلني أفكر ، في حالته الحالية ، ما الهدف من هذا الذكاء الاصطناعي السحري؟ إذا كان لا يمكن أن يكون صحيحًا 100 ٪ من الوقت ، فهل هي في الواقع أداة مفيدة؟ إذا كنت بحاجة إلى التحقق من المعلومات التي أطلبها ، وتحقق من إجاباتها ، فهل أحصل على أي استخدام من هذه التقنية؟

الشيء هو ، إذا كان الذكاء الاصطناعى على حق 99 ٪ من الوقت (وهو ليس كذلك) ، فهذا ليس جيدًا بما يكفي للعمل بشكل مقنع لغرضه المقصود. إذا كانت أدوات البحث العميقة لا تزال بحاجة إلى التحقق للتأكد من عدم وجود أخطاء ، فمن الأفضل لك تجميع البحث بنفسك.

وهذه هي مشكلتي مع الذكاء الاصطناعي. حتى يمكن أن يكون دقيقًا بنسبة 100 ٪ 100 ٪ من الوقت ، فهي مجرد أداة وسيلة للوصول يمكن أن تفعل بعض الأشياء بشكل جيد وغيرها من الأشياء سيئة. لا تخطئني ، أعتقد أن chatgpt وأدوات الذكاء الاصطناعي الأخرى فعالة ويمكنها إكمال بعض المهام. ومع ذلك ، لكي تصبح التكنولوجيا الرائدة التي يريدها Altman و Co أن تفكر في أنها ، تحتاج هذه الأدوات إلى محو الأخطاء تمامًا – وبصراحة تامة ، نحن في أي مكان بالقرب من هذا الواقع.